FaceShot是什么

FaceShot是同济大学、上海 AI Lab和南京理工大学推出的新型无需训练的肖像动画生成框架。用外观引导的地标匹配模块和基于坐标的地标重定位模块,为各种角色生成精确且鲁棒的地标序列,基于潜在扩散模型的语义对应关系,跨越广泛的角色类型生成面部动作序列。将地标序列输入预训练的地标驱动动画模型生成动画视频。FaceShot突破对现实肖像地标的限制,适用于任何风格化的角色和驱动视频,或作为插件与任何地标驱动的动画模型兼容,显著提升整体性能。

FaceShot的主要功能

角色动画生成:为各种类型的角色生成流畅且自然的面部动画,保持角色的原始特征。

跨领域动画:支持从人类视频驱动非人类角色(如玩具、动物等)的动画,扩展肖像动画的应用范围。

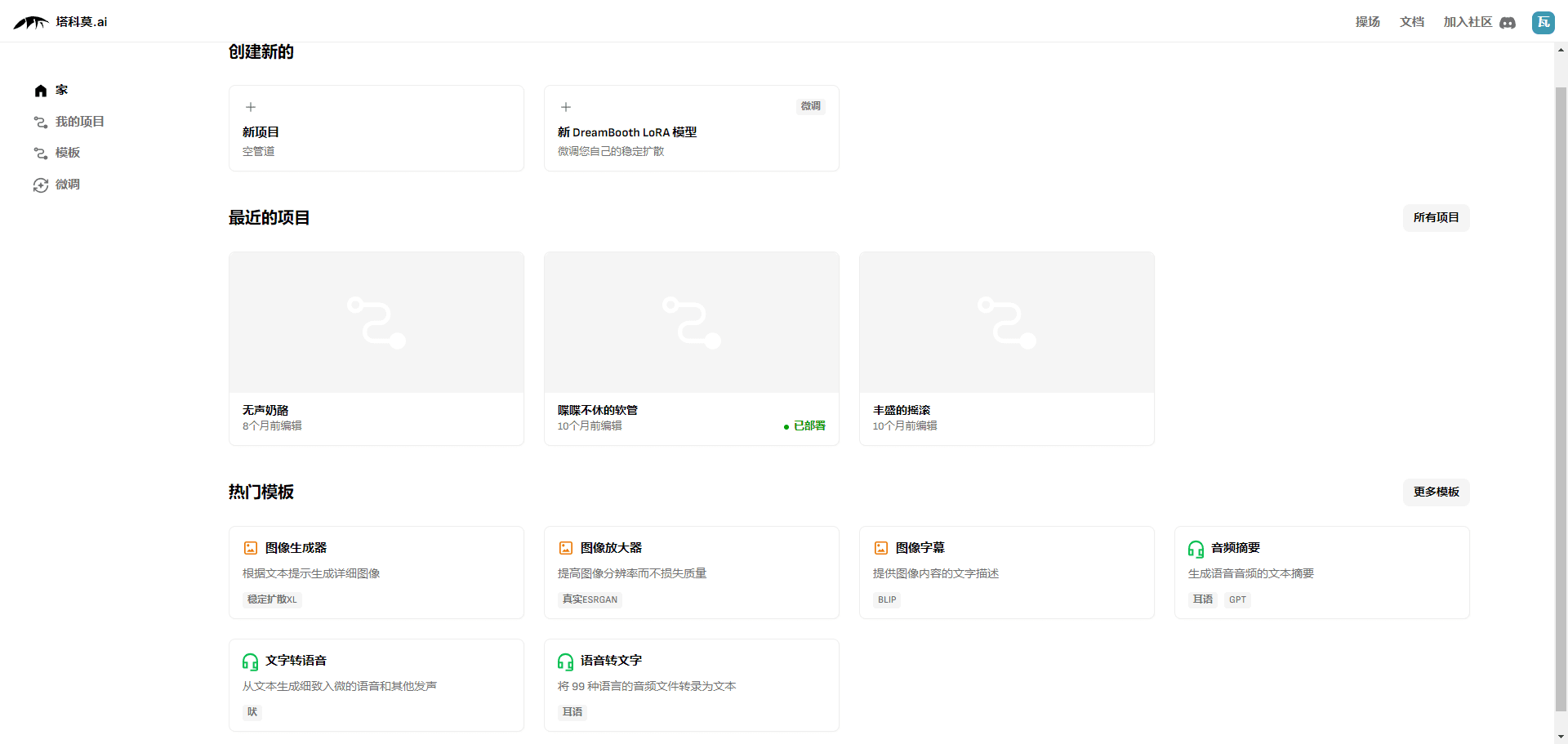

无需训练:无需针对每个角色或驱动视频进行额外的训练或微调,直接生成高质量的动画。

兼容性:作为插件与任何地标驱动的动画模型无缝集成。

FaceShot的技术原理

外观引导的地标匹配模块:基于潜在扩散模型的语义对应关系,结合外观先验知识,为任意角色生成精确的面部地标。用DDIM逆过程从参考图像和目标图像中提取扩散特征,基于图像提示减少不同领域之间的外观差异。用余弦距离进行地标匹配,确保地标在语义上的一致性,引入外观画廊进一步优化匹配效果。

基于坐标的地标重定位模块:基于坐标系变换捕捉驱动视频中的细微面部动作,生成与之对齐的地标序列。模块分为全局运动和局部运动两个阶段,全局运动负责计算面部的整体平移和旋转,局部运动则分别对眼睛、嘴巴、鼻子、眉毛和面部边界等部分进行相对运动和点运动的重定位。基于简单的坐标变换公式,模块能精确捕捉面部的全局和局部运动,生成稳定的地标序列。

地标驱动的动画模型:模块将生成的地标序列输入预训练的动画模型(如MOFA-Video),生成最终的动画视频。将地标序列作为额外条件输入到动画模型的U-Net中,确保模型能精确跟踪地标序列中的运动。基于这种方式,动画模型能用地标序列生成与驱动视频一致的动画效果,保持角色的视觉身份,实现高质量的肖像动画生成。

FaceShot的项目地址

项目官网:https://faceshot2024.github.io/faceshot/

GitHub仓库:https://github.com/open-mmlab/FaceShot

arXiv技术论文:https://arxiv.org/pdf/2503.00740

FaceShot的应用场景

影视娱乐:为电影、电视剧中的角色生成生动动画,提升视觉效果。

游戏开发:快速生成游戏角色动画,增强表现力和趣味性。

教育领域:使教育内容更生动,提高学生学习兴趣和教学互动性。

广告营销:生成品牌吉祥物动画,提升品牌形象和用户参与感。

VR/AR应用:生成虚拟角色动画,提升沉浸感和交互体验。